שיטה חדשה ב-Explainable AI מפרידה בין רכיבים כלליים בתמונה לבין רכיבים שמטים את ההחלטה, ועוזרת לאתר הטיות וקיצורי דרך

כשמודל בינה מלאכותית מבצע סיווג תמונה (למשל: “חתול”, “כלב”, “גידול”), לא מספיק לדעת אם הוא צדק. צריך להבין למה הוא הגיע למסקנה הזו. כאן נכנס תחום Explainable AI (XAI): ניסיון לתת הסבר שניתן לבדוק, לבקר ולהבין.

אחד הכלים הנפוצים להסבר הוא “מפת חום” (heatmap) – הדגשה צבעונית של אזורים בתמונה שהמודל “ייחס להם חשיבות”. הבעיה היא שמפות כאלה עלולות להיות לא יציבות או מטעות: לפעמים הן מציגות איפה המודל “הסתכל”, אבל לא באמת מבהירות מה בתמונה דחף את ההחלטה, ומה היה רק רעש או צירוף מקרים.

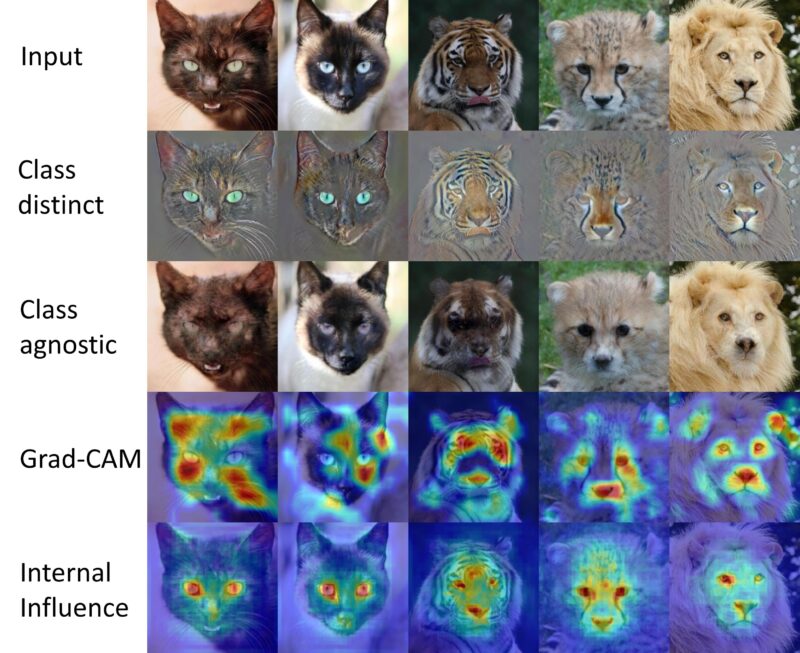

מחקר חדש מציע חלופה: DXAI – Decomposition-based Explainable AI, שמחליפה את ההדגשה הצבעונית בפירוק של התמונה לרכיבים שממחישים מה כללי ומה מכריע בהחלטת הסיווג.

למה “מפת חום” לא תמיד מספיקה

במפות חום התוצאה היא בדרך כלל שכבה צבעונית על גבי התמונה: פה אדום, שם צהוב. זה יכול להיות שימושי, אבל גם משאיר שאלות פתוחות:

- האם המודל הסתמך על האובייקט עצמו, או על הרקע?

- האם הוא למד “קיצור דרך” (למשל סימן מים, מסגרת, שולחן קבוע)?

- האם ההסבר משתנה אם מזיזים קצת את התמונה או משנים תאורה?

במילים אחרות: מפה צבעונית יכולה להיות אינטואיטיבית, אבל לא תמיד מסבירה באופן שאפשר לבדוק לעומק. (ar5iv)

מה DXAI עושה אחרת

DXAI מנסה לענות על שאלה אחרת:

לא “איפה המודל הסתכל?”, אלא “איזה חלקים בתמונה בנו את ההחלטה?”

במקום לצבוע אזורים, השיטה מפרקת את התמונה לרכיבים, כך שהתמונה מוצגת כסכום של “שכבות”/מרכיבים:

- רכיבים כלליים: דברים שמאפיינים הרבה תמונות, בלי קשר לסיווג (למשל תאורה, מרקם נפוץ, מבנה כללי).

- רכיבים מבחינים: דברים שמטים את ההחלטה לסיווג מסוים (למשל צורה/מרקם שמבדילים “חתול” מ“כלב”, או מאפיין שמבדיל בין שתי מחלקות דומות).

כך מתקבל הסבר יותר “מפורק”: אפשר לראות מה נראה כמו בסיס כללי של התמונה, ומה נראה כמו החלקים שמכריעים את הסיווג.

החוקרים מדגישים גם יתרון פרקטי: ההסבר מתקבל בלי להסתמך על גרדיאנטים של הרשת (כלומר בלי חלק מהרגישויות שמאפיינות “מפות חשיבות” קלאסיות), ויש להם גם קוד פתוח להדגמות וניסויים.

למה זה חשוב במיוחד ברפואה, בטיחות ותעשייה

בתחומים רגישים, הסבר הוא חלק מהאמון:

- ברפואה: אם מודל מסווג צילום הדמיה, חשוב לדעת אם הוא נשען על מאפיין רפואי, ולא על ארטיפקט טכני.

- בתעשייה ובטיחות: אם מודל מזהה “תקלה”, חשוב לוודא שהוא באמת מזהה את התקלה ולא שינוי תאורה.

- במשפט וברגולציה: לפעמים חייבים הסבר שאפשר להציג ולהגן עליו.

הגישה של DXAI יכולה לעזור לאתר הטיות וקיצורי דרך מוקדם יותר, כי היא מנסה להראות מה בדיוק בתמונה “דחף” את הסיווג.

כמובן, גם כאן אין קסמים: פירוק תלוי בנתונים, במסווג, ובהגדרות הניסוי. אבל זה כיוון שמרחיב את ארגז הכלים של XAI, במיוחד כשמפות חום מרגישות “יפות” אבל לא מספיק חדות להסבר אמיתי.

עוד בנושא באתר הידען: