ייתכן שההצלחה של ChatGPT דורשת מאיתנו לעדכן את המושגים שלנו לגבי מהי ״מחשבה״, מהי ״יצירתיות״ ומהו ״דיבור״. האם ChatGPT חושב ומדבר כמונו, או שמדובר בחיקוי של הדבר האמיתי? מה זה אומר על המחשבה אם מודל AI יכול לחשוב, ומה זה אומר עלינו אם אפשר לעשות חיקוי כל כך קרוב למציאות?

בשנים האחרונות, מודלים של בינה מלאכותית (להלן AI) מוכיחים שוב ושוב שהם יכולים לעשות לא מעט דברים שחשבנו שהם נחלתינו הבלעדית כבני אדם. ChatGPT, המפורסם שבהם שפותח על ידי OpenAI, מסוגל בהינתן שאילתא מהמשתמש לייצר טקסט מקורי שמפגין לא רק הבנה של השאילתא וההקשר וידע נרחב אלא יכולת יצירתית בלתי מבוטלת. רבים רואים בכך איום על העתיד התעסוקתי שלהם ועל החברה בכללותה, וכנראה בצדק. אך פן נוסף שלא זוכה למספיק התייחסות לדעתי הוא הצל שמטילים ChatGPT ודומיו על התפיסה שלנו את עצמינו כבני אדם. ייתכן שההצלחה של ChatGPT דורשת מאיתנו לעדכן את המושגים שלנו לגבי מהי ״מחשבה״, מהי ״יצירתיות״ ומהו ״דיבור״. האם ChatGPT חושב ומדבר כמונו, או שמדובר בחיקוי של הדבר האמיתי? מה זה אומר על המחשבה אם מודל AI יכול לחשוב, ומה זה אומר עלינו אם אפשר לעשות חיקוי כל כך קרוב למציאות?

ChatGPT ושפה אנושית

לודוויג ויטגנשטיין (1889-1951), אחד מגדולי הפילוסופים של המאה ה-20 ובפרט בהקשר של שפה, קידם את הרעיון של ״משמעות כשימוש״. הוא התנגד לתפיסה שהשפה היא רק ביטוי מילולי למחשבה שקדמה לה: שקודם ידענו משהו, ורק אז ביטאנו אותו בשפה; שקודם היתה המשמעות, ואז הומצאה המילה שמתווכת אותה. למרות שבעצמו אחז בתפיסה דומה בתחילת דרכו (כמו רוב בני זמנו), לבסוף הוא הגיע למסקנה שתפיסות כאלה רק מבלבלות אותנו. לשיטתו, המשמעות של המילים מגיעה מהאופן שבו משתמשים בהן. ליתר דיוק, השימושים של המילה הם המשמעות שלה. אין ספק שChatGPT יודע להשתמש במילים, וזה מה שהופך אותו למקרה מסקרן בשביל לבחון את התפיסה הזו.

תהליך האימון של ChatGPT מעלה שאלות לגבי הקשר בין שפה ומציאות. המודל מסוגל לייצר שפה קוהרנטית ובעלת משמעות בהתבסס על תבניות סטטיסטיות ויחסים בין מילים, בלי שבהכרח תהיה לו הבנה של אובייקטים בעולם האמיתי, או של מושגים שהשפה מתייחסת אליהם. זה מדגיש את הרעיון שהקשר בין השפה והמציאות הוא מורכב ולא תמיד פשוט וישיר.

הציטוט לעיל נכתב על ידי ChatGPT עצמו (בתרגום שלי), ומתייחס, בעמימות אופיינית, למתח בין שימוש והבנה. כבני אדם, יש לנו היכרות ישירה עם העולם. אנחנו יכולים לדבר על ״כסא״ וגם לשבת על הכיסא, להרים אותו, להסתכל עליו, לבנות אותו או להרוס אותו; אנחנו יכולים לדמיין כסאות, להרהר בהם ולהרגיש כלפיהם דברים. ChatGPT יכול רק לדבר על כיסאות, אבל איכשהו, למרות שאין לו את כל שאר החוויות שלנו יש בהקשר של כיסאות, הוא יכול לדבר עליהם בצורה קוהרנטית לחלוטין, שלא מסגירה כלל את חוסר הנסיון שלו עם העולם האמיתי. אכן, הקשר בין השפה והמציאות הוא ״לא תמיד פשוט וישיר״ (במקור: straightforward).

ChatGPT הוא מודל AI שמבוסס, בהפשטה, על למידה של קשר סטטיסטי בין מילים. המודל בנוי כך שבהינתן טקסט הוא יודע לפלוט ניחוש של המילה הבאה בו. לפני שמאמנים אותו, הוא מנחש מילות ג׳יבריש, אך בתהליך האימון הוא ״קורא״ כמויות אדירות של טקסטים, ומפעיל אלגוריתם למידה שמכוונן אותו בהתאם למילים שמופיעות בטקסט. כך עם הנסיון הוא לומד להחזיר מילים שסבירות שיופיעו בהמשך לטקסט שנתנו לו. במילים אחרות, בהינתן טקסט מסוים (או שאילתא מצד המשתמש), ChatGPT מחזיר את המילה שהכי סבירה, באופן סטטיסטי, שתופיע בהמשך לטקסט הזה. לאחר מכן הוא יחזיר עוד מילה, ועוד מילה, עד שהוא יגיע לעצירה. וזאת בעוד שבשום שלב בתהליך הלמידה אין מי שיעזור לו לראות את הקשר בין המילים ובין אובייקטים בעולם. איש אינו מציג מולו כיסא, או נותן לו לשבת עליו, ועוזר לו לצרף למילה משמעות.

בחלק גדול מהגותו, ויטגנשטיין מנסה להפריד בין הפרקטיקה למה שעומד מאחוריה, שהוא בלתי נגיש. ChatGPT הוא מקרה המבחן האולטימטיבי לגישה שלו, בכך שהפרקטיקה שלו – הכתיבה – דומה מאוד לשלנו, בעוד שאנחנו יודעים שמה שעומד מאחוריה אינו אנושי. אם המשמעות היא אכן בשימוש, אז אין כל הבדל בין אמירה של אדם ואמירה של AI.

באחד החלקים החשובים בספרו חקירות פילוסופיות (הוצאת מאגנס, 2013), ויטגנשטיין עוסק ב״עקיבה אחר כלל״ (סעיפים 138-242). הוא טוען שם שבעוד שנדמה לנו לפעמים שאנחנו יכולים להקיף משהו במחשבה, למשל שיר, פעולה מסוימת או את מושג האינסוף, למעשה אנחנו לא יכולים (או צריכים) להחזיק את הדבר כולו בבת אחת. מה שיש לנו זה את היכולת להתקדם צעד אחר צעד. אנחנו יודעים, אחרי שזימזמנו את הבית הראשון, מה השורה הראשונה של הפזמון. אנחנו יודעים לקחת כל מספר ולהוסיף לו 1. אנחנו יודעים, בהינתן שיחה עם מישהו, להגיד את המשפט הבא. זאת המשמעות של להכיר שיר, להבין את האינסוף ולדעת לנהל שיחה. כך, כשאנחנו מבינים נושא מסוים, כשאנחנו יודעים משהו, הדבר שאותו אנחנו יודעים הוא הכלל שעוקבים אחריו.

מטענותיו של ויטגנשטיין משתמע, להבנתי, שמה שמאפיין אותנו הוא הדיספוזיציות שלנו. יש לנו מכשיר מנטלי מסוים שבהינתן מצבים שונים מוציא פלטים שונים. אם המכשיר הזה יודע להוסיף 1 לכל מספר, האדם מבין את המושג ״אינסוף״. אם הוא יודע להמשיך את השיר, הוא מכיר את השיר. אם הוא כותב את השורה הבאה בהוכחה, הוא מבין מתמטיקה. אבל ויטגנשטיין לא דמיין אותנו כאוטומטים. יש לנו גם עולם מנטלי, יש לנו חוויות פנימיות ורגשות, הם פשוט לא חלק מהניתוח של איך שאנחנו משתמשים בשפה.

הבעיה הפילוסופית שמציב ChatGPT נובעת בדיוק מזה שאין לו עולם פנימי שדומה לשלנו, אבל הוא בכל זאת מדבר כמונו. הוא מצליח לעקוב אחרי אותם כללים כמונו, להשתמש בשפה כמונו. אם מקבלים את ההגדרה של ויטגנשטיין של משמעות כשימוש, אין יותר דבר כזה ״חיקוי״ של שפה. מי שיודע להשתמש במילים גם מבין אותן. ואם ChatGPT מבין את המילים מבלי שאי פעם היתה לו נגיעה לדברים עצמם, מבלי שהוא ראה כיסא, ישב עליו, הרגיש אותו או קיבל ממנו מכה באצבע, במה טובה ההבנה שלנו משלו, אם בכלל? אם אפשר לדעת הכל על העולם רק מתוך למידה של קשרים סמנטיים בין מילים, מה הערך בכל החוויות האלה שצברנו?

להיות ChatGPT

ChatGPT מאפשר לנו הבנה ברורה יותר של ״משמעות כשימוש״ ושל ההשלכות של הרעיון הזה. אם להבין שפה זה לדעת לדבר (או לכתוב), זה משנה את מה שאנחנו מבינים על עצמינו ועל היכולת שלנו לחשוב. יש לנו דיספוזיציות מסוימות, חלקן מודעות וחלקן לא, ובעזרתן אנחנו יוצרים את השפה תוך כדי דיבור או כתיבה. לעולם הפנימי שלנו אין תפקיד ברור בתהליך הזה. זה לא אומר שהוא לא חשוב לדברים אחרים: רגשות עוזרים לנו לעבד מידע, יש לנו תחושות שמכווינות אותנו לגבי איזה מידע לקבל ולמה להתנגד וכדומה. כל אלה עוזרים לעצב אותנו. אך בהינתן ״שאילתא״, אנחנו שמים את זה בצד ופשוט מתחילים לייצר דיבור.

מעניין להיווכח שתהליך לימוד השפה שלנו אינו מניח הבנה. כאשר ילדים לומדים את המילים הראשונות שלהם, הם לומדים אותן לא דרך הבנה של משמעות אלא דרך שימוש (ויטגנשטיין מתייחס ללמידה של שפה בחקירות פילוסופיות, סעיפים 1-21). הם לומדים שבמצבים מסוימים אומרים דברים מסוימים. אנחנו אומרים להם: ״תגידי אמא. א-מא״. אנחנו מבקשים שישלימו משפטים: ״אחת שתיים שלוש, ידיים על ה-״. אנחנו מלמדים אותם לקשר מצב למילה: ״תגיד ביי״. וזה ממשיך כך שנים רבות. אנחנו אומרים ״בתיאבון״ בלי להרהר ב״משמעות״ של המילה. כך גם עם המילים ״אמֶן״, ״מזל טוב״, ״בהצלחה״. ניתן לומר שאנחנו מלמדים ילדים לעקוב אחרי כללים. הם לומדים באופן סטטיסטי מהי המילה הבאה שצריכה להיאמר.

כמובן, הלמידה של ילדים היא קשה הרבה יותר משל ChatGPT: עולם הגירויים הרבה יותר מורכב ועשיר וכולל לא רק טקסט. הם צריכים לא רק להבין מה צריך להגיע עכשיו אלא גם איך לבטא את זה ואל מי, ומתי מדברים אליהם. בשביל זה הם אכן צריכים להכיר איך נראה ומרגיש ״כיסא״. הם צריכים את היד שתצביע להם על האובייקט בו בזמן שהם שומעים את השם שלו. אבל הרבה פעמים אפשר גם בלי זה, וכשמדובר במושגים מופשטים אין אפילו על מה להצביע. במילים אחרות, אנחנו מתחילים מלהבין את השימוש, והקישור המנטלי מצטרף אחר כך, או במקרים מסוימים לא מצטרף לעולם, או נשאר מעורפל.

אולי היכולת שלנו להשתמש בשפה פחות קשורה להבנה ממה שאנחנו רגילים לחשוב. אולי כשאנחנו לומדים לדבר, אנחנו בסך הכל לומדים לדבר. לתחושות, רגשות ואופי שלנו יש תפקידים אחרים. הדיבור הוא רק פעולה. כשאנחנו מתחילים את הפעולה הזו, אנחנו לא תמיד יודעים איך זה יסתיים ולאן נגיע. לפעמים ברור לנו מה ההמשך של המחשבה, ולפעמים יש חוסר וודאות (מה שבוודאי נכון גם אצל ChatGPT: לפעמים יש מילה אחת עם הסתברות גבוהה, ולפעמים כמה עם הסתברות נמוכה). לפעמים הדיבור שלנו קולח ולפעמים אנחנו נתקעים באמצע, או צריכים לחזור אחורה ולתקן. לפעמים אנחנו מגיעים למסקנות שמפתיעות אותנו. לפעמים אנחנו מגלים שה״שאילתא״ מכתיבה את המסקנות שאליהן נגיע, דבר שגם קורה לChatGPT.

אולי השימוש שלנו בשפה הוא בסך הכל עקיבה אחר כלל. זה כלל שהוגדר על ידי מי שאנחנו והחוויות שלנו, ולכן הוא שלנו, במובן מסוים. אבל התוצאה היא לא ממש שלנו. אולי נכון לחשוב על דיבור יותר כמו על הרגל: ההרגל הוא שלנו, כשהתוצאות שלו לא טובות, אפשר ורצוי לשקול לשנות אותו.

לחשוב, צעד אחר צעד

כשChatGPT ״חושב״, הוא יכול ״לייצר הנחיות מזיקות או תוכן מוטה״ ו״לייצר מידע שגוי״, כפי שמזהירים אותנו באתר. גם אנשים, כמובן, מייצרים הנחיות מזיקות ותוכן מוטה ושגוי. ברשתות חברתיות, בטוקבקים וגם בויכוחים שבהם חשוב לנו לנצח. אולי ההבדל בינינו לבין ChatGPT לא גדול כל כך. אנחנו מקבלים אינפוט כלשהו מהעולם ומתחילים לחשוב בשפה. מה גורם לנו להאמין שהמחשבות שלנו הן בהכרח המחשבות ה״נכונות״? איך אתם יודעים אם התגובה שלכם למאמר הזה היא תגובה נכונה, או מועילה? לפי איזה קריטריונים?

בעבר כתבתי פה על מאמיני הארץ השטוחה שיש להם שיטה מסוימת של רכישת ידע, שבעזרתה הם הגיעו למסקנה שהארץ שטוחה. ניסיתי לטעון שאם הם יבחנו את השיטה עצמה, ולא רק את הטיעונים, הם יוכלו בנקל לראות למה אין סיכוי להצליח עם שיטה כזאת. אבל זה יותר קל להגיד מלעשות, וכנראה שאף ״שטוחיסט״ לא השתכנע.

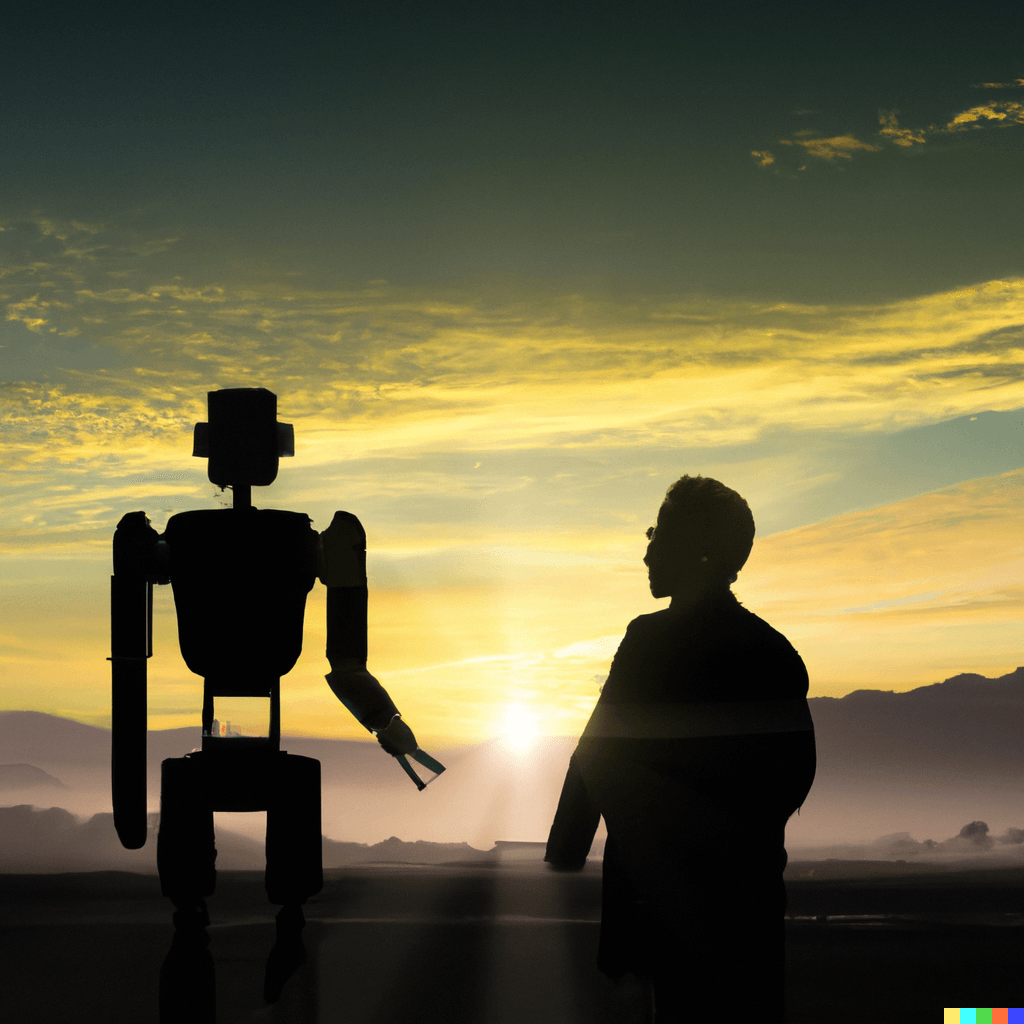

זה לא בהכרח קל או מובן מאליו למצוא קריטריון אובייקטיבי בשביל לשפוט את המחשבות שלנו, וזו בעיה שמעסיקה בין השאר פילוסופים שמנסים להגדיר מהי אמת, פסיכולוגים שמנסים למצוא דרך מיטיבה לחשוב, הוגים פוליטיים שמנסים לפתח דרכים לגשר על הקיטוב החברתי ועוד. זה אחד הדברים שChatGPT (עדיין) לא יודע לעזור לנו בהם, אבל הוא יכול לתת לנו השראה להיות פחות קנאים לדעות שלנו ולאפשר לנו לראות נקודות מבט שונות. אחר כך נצטרך להחליט בעצמינו איזה מהן טובות יותר. זו (עדיין) האחריות הבלעדית שלנו כבני אדם, ואולי בכך (עדיין) מותר האדם מהמכונה.

הערות

- במאמר זה לקחתי את הפילוסופיה של ויטגנשטיין כדבר נתון. התפיסה שלו היא דומיננטית למדי כיום, אך (כמו לכל תפיסה פילוסופית) יש לה מתנגדים עם דעות שונות. למבוא מוצלח על הפילוסופיה של ויטגנשטיין ופילוסופיה של השפה בכלל: Contemporary Analytic Philosophy / Karl Munitz.

- חואן לואיס גסטאלדי הוא הסטוריון של המדע שבין השאר עוסק בהשלכות האפיסטמולוגיות של AI על עולם המתמטיקה, והרצאה שלו בנושא היוותה השראה חשובה לפוסט.

- הציטוט של ChatGPT במאמר הגיע כתשובה לשאילתא ״Explain how chatGPT was trained״ ואז ״Relate that to philosophy of language and meaning״. האם הצלחתם להוציא ממנו תוצאות שונות ומעניינות בנושא?

9 תגובות

מעניין ביותר. תודה רבה.

נוצת ציפור שעפה ברוח

מצאה חברה בציפור קטנה

שמשתעשעת בתפיסתה

מלמדת אותה לעוף ולשיר,

שיר של חיות וטבע

שיר של אהבה

שיר של חופש ואומץ

שיר על נוצה וציפור,

נוצת הציפור הייתה לבד

בעולם הרחב והגדול

אך כשראתה את הקטנה

חייכה לה בידידות ובלב שמח.

נכתב לבקשתי מ CHAT GPT של מיקרוסופט שיכתוב לי שיר קצר שיש בו את המילים נוצה ציפור..

שמוליק,

זה נכון, הטענה שלי בעצם רלוונטית רק לתקשורת כתובה, שזה הדבר היחיד שGPT יודע, וזו תקשורת שלא מתכתבת באופן ישיר עם דברים בעולם (כמו התקשורת בינינו כרגע).

מה שאתה טוען לגבי הכיסא זה שGPT משתמש במילה ״כיסא״ באופן אחר, ואם זה באמת נכון אז גם לפי ויטגנשטיין הוא מבין את המילה באופן (קצת) אחר, אבל אני לא בטוח שזה נכון שהוא לא יידע להגיד שפח וענף אלה דברים שאפשר לשבת עליהם.

אני לא פרופסור, ואני לא יודע איך אתה מגדיר ״יצירתיות״, אבל למה לא?

האם יש מקום, פרופסור דותן רייס, לדבר על "יצירתיות" (אנושית או של מערכת AI) שלא בהקשר של "כושר המצאה"?

מאמר מרתק.

יש לי שתי הערות שאולי גם מרמזות בכל זאת על הפער בין אינטלגנציה טבעית למלאכותית.

1. ויטגנשטיין אמנם דיבר על המשמעות כשימוש אך לא התכוון לשימוש בשפה במנותק מהמציאות. להיפך, בכדי להבין את המשמעות צריך להתבונן בשימוש בשפה בתוך הסיטואציה, במציאות היומיומית שבה נעשה השימוש המסויים. שפה לכן, קשורה קשר הדוק לצורת החיים. הסטטיסטיקה לא משקפת את העושר העצום של מצבים במציאות וקל אולי להבין זאת מהדוגמה הבאה: על השאלה מה כדאי לעשות אם פורצת שריפה בחדר בו אני נמצא – ה GPT יפרט את הצעדים האפשריים בצורה טובה.

אבל אם אכן תפרוץ שריפה בחדר ה GPT לא יצעק בקול "צא מהר מהחדר!" כפי שכל אדם עם מעט "שכל ישר" היה עושה.

2. במושגי השפה היומיומית קיימת עמימות במובן שקשה למצוא הגדרה מדויקת למושג כך שתכיל את כל האובייקטים ששייכים למושג ורק אותם (ע"ע קבוצה בתורת הקבוצות).

אפשר לראות זאת למשל עם המושג "כסא".

האם כסא הוא מה שצורתו 4 רגליים, מושב ומשענת או אולי כל מה שאפשר לשבת עליו ? אף אחד מההגדרות לא כוללת וממצה.

העמימות הזו בשפה מאפשרת את הגמישות בשימוש ע"פ מצבי מציאות שונים וגם חדשים.

כך פח, ענף של עץ או מזוודה יכולים להיות כסא במידת הצורך. ה GPT למשל, יתקשה להציע ענף של עץ ככסא אם סטטיסטית השימוש הזה נדיר או לא קיים.

שתי ההערות מצביעות על פער בין 'הבנה' של AI לבין 'הבנה' של בינה טבעית לפחות כאשר מדובר ביחס בין השפה למציאות. זה גם יכול להסביר מדוע ה GPT מייצר תשובות כוזבות בכזו קלות.

חלילה לי לזלזל בויטגנשטיין. הוא סבר כי על הפילוסופיה לקבוע תחומי גבול באשר לסיפרת הויכוח בתחומי מדעי החיים למיניהם. לדידו הפילוסופיה אינה גוף של דוקטרינות אלא משהו פעיל המובסס על הלוגיקה. בסופו של דבר הוא הגיע למסקנה כי

“What can be shown cannot be said” (ראה: Tractatus Logico-Philosophicus מאת ויטגנשטיין פרקים 4.005 – 4.112). אולם טענתי היא שאין חייבים לתחום תחום החשיבה של מה מקובל ומה לא, אלא לפרוץ את המסגרת ולהוכיח את הכשלים שלה וזאת עושים באמצעות דברים החורגים מגדר ״הרגיל״ למשל זנבות שמנים, בדומה להוגים והמדענים אשר היו גם לפילוסופים הראשונים של מכניקת הקוונטים, הייזנברג, איינשטין ובוהר (ככל הידוע לי איש מהם לא למד בקתדרה לפילוסופיה).

1 – נניח שיש ישראל ישראלי כזה ובחמישה אתרים שונים כתוב שהוא אנס ורוצח. וישאלו אותך מי זה ישראל ישראלי. לא תגיד שהוא אנס ורוצח?

2 – נראה לי שאתה קצת מזלזל בויטגנשטיין אם אתה חושב שהוא היה זורק את התיאוריה שלו לפח אם הוא היה מודע לכך שאפשר לקודד שפה ב0 ו-1. אני לא רואה בזה משהו מאוד משמעותי מבחינה פילוסופית.

חבל לערבב תפוזים ותפוחים. ויטגנשטיין בזמנו לא היה מודע לשפה בינארית של מחשב עליו מבוסס ה ChatGTP, קרי 0 או 1. הבינה המלאכותית מתבססת על סטטסיטקה ואת הסטטיסטיקה קל מאד לעוות. נניח וישנו מאין דהו בשם ישראל ישראלי, איש ישר דרך וזך כשלג. אני יכול לפתוח חמישה אתרים שונים במדינות שונות ולכתוב שאותו ישראל ישראלי הוא אנס ורוצח. התוצאה תהיה שאם ישאלו את ChatGTP מיהו מר ישראלי? ישראלי נקבל תשובה שהאיש אנס ורוצח. על אותו המשקל, ואף חשוב יותר, היא האקראיות. בשפה בינארית אין אקראיות טהורה, רק פסדו-אקראיות, וגם כאן כמו בסטטיסטיקה ניתן לעוות את האקראיות בכך שמוצאים את נקודות החולשה שלה. הלקח נלמד ממאות המילארדים שנמחקו מהשווקים הפיננסים בעקבות מודלים המבוססים על סטטיסטיקות ופסדו-אקראיות ולרוב בגלל מאורעות של זנבות שמנים (התפלגויות זנבות עבים) או גבנוניות (קורטוזיס) גבוהה.